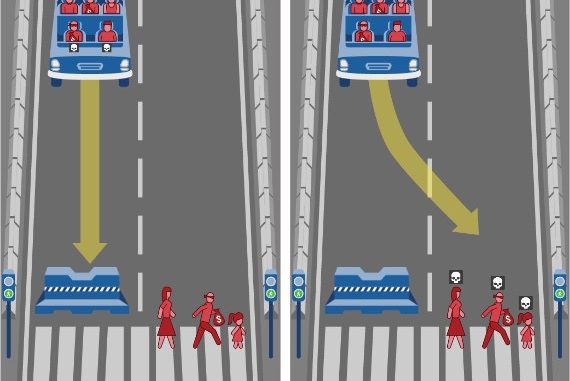

Quando le macchine si guideranno da sole e si parleranno, come faranno a scegliere il minore tra due mali? Favoriranno il proprio guidatore o sceglieranno in base al numero, all’età o al contributo sociale delle vittime? La macchina spacciata sceglierà di frenare e uccidere un importante premier pacifista che potrebbe evitare una guerra o non frenare e schiantarsi contro uno scuolabus pieno? Per avere un punto di vista “umano” che si sommi ai freddi calcoli di un computer il MIT ha anticipato i tempi e creato una “moral machine” che pone dilemmi morali e chiede una soluzione. I più creativi possono perfino proporre una particolare situazione.

Link: http://42h.it/2cOo1cx

1 Trackback / Pingback

I commenti sono bloccati.